2025年、私たちはAI活用の歴史的な転換点に立っています。これまで「チャットボット」としてテキストを生成するだけだったAIが、画像や音声、ビデオを理解し、さらにPCやツールを自律的に操作する「デジタル社員」へと進化を遂げました。

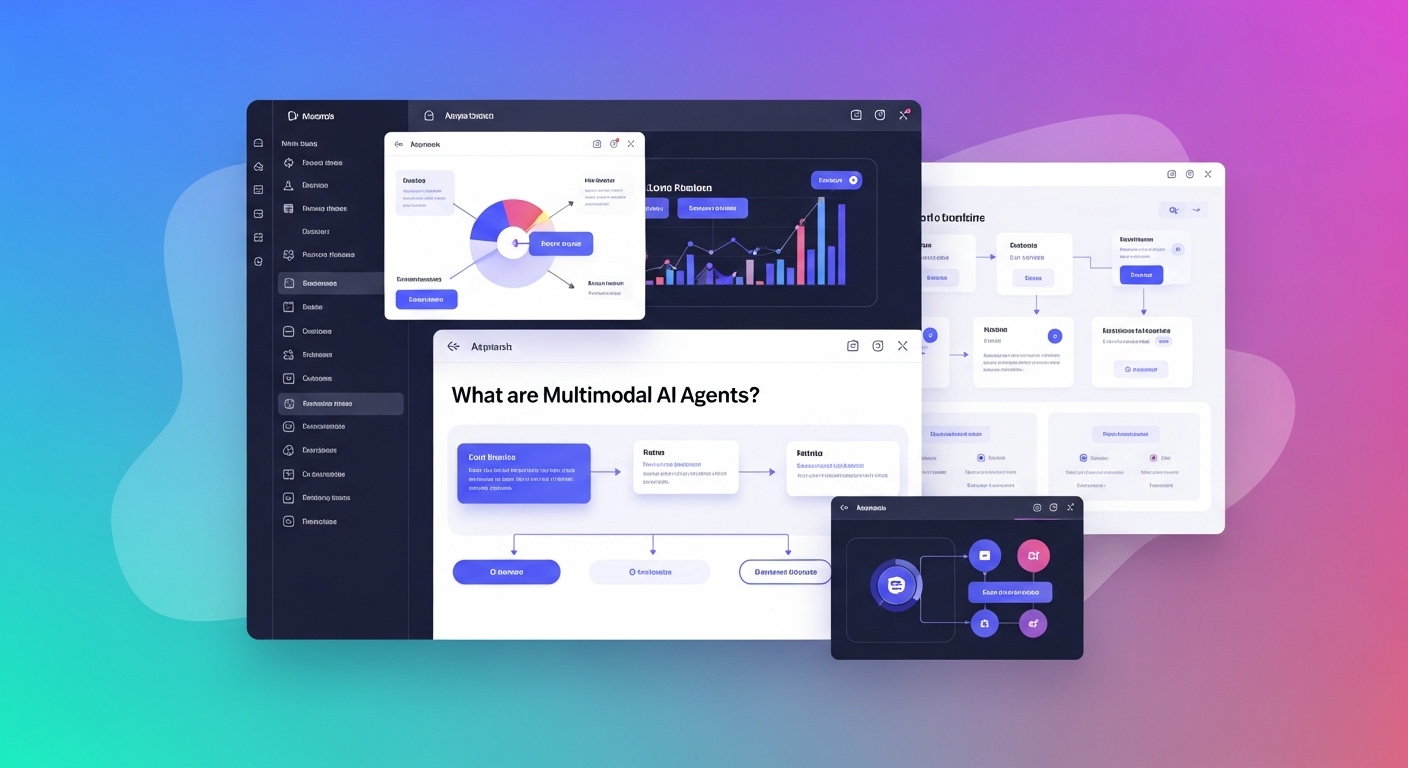

結論から申し上げます。「マルチモーダルAI」と「AIエージェント」の融合こそが、今、最も投資対効果(ROI)の高い技術トレンドです。

ガートナーの予測では、2027年までに生成AIソリューションの40%がマルチモーダル化すると言われています。なぜこれほど注目されるのか?それは、人間が画面を見て(視覚)、指示を聞き(音声)、マウスを動かす(行動)のと同じように、AIが複雑なワークフローを完結できるようになったからです。

この記事では、最新の事例や具体的なROIデータを交えながら、この技術がビジネスをどう変えるのか、そして企業はどう導入すべきかをエンジニア視点で徹底解説します。

マルチモーダルAI × エージェント:なぜ「最強」の組み合わせなのか

まず、技術的な背景を整理しましょう。多くの人がこの2つを混同していますが、役割は明確に異なります。

- マルチモーダルAI(脳と感覚器): テキストだけでなく、画像、音声、動画を同時に理解・生成する能力。GPT-4oやGemini 1.5 Proが代表例です。

- AIエージェント(手足と行動): 自律的に計画を立て、ツール(ブラウザ、Excel、社内システム)を操作してタスクを実行する機能。

これらが融合することで、例えば「Zoom会議の録画データ(動画)を見て、重要な決定事項を抽出し(マルチモーダル処理)、Jiraでタスクチケットを作成して担当者にSlackで通知する(エージェント行動)」といった一連の流れが、人間の介入なしで完了します。

従来の自動化(RPA)との決定的違い

多くの企業が導入しているRPA(Robotic Process Automation)と何が違うのでしょうか?以下の表にまとめました。

| 機能・特性 | 従来型RPA | LLM単体(チャットボット) | マルチモーダルAIエージェント |

|---|---|---|---|

| 得意なタスク | 定型作業(ルールベース) | 文章作成、要約、翻訳 | 非定型・判断が必要な複合タスク |

| 入力データ | 構造化データ(Excelなど) | テキスト中心 | 画像、音声、動画、画面UI |

| 柔軟性 | 低い(UI変更で止まる) | 高い(会話が可能) | 極めて高い(自己修復・適応) |

| 導入ハードル | プログラミング/シナリオ設計 | プロンプト設計 | 自然言語でのゴール指示 |

RPAが「決められたレールを走る電車」だとすれば、マルチモーダルAIエージェントは「地図を見て目的地まで自分で運転するタクシー」です。UIのデザインが変わっても、AIは「送信ボタン」を視覚的に認識してクリックできます。

【実証された効果】驚異的なROI事例と活用シーン

抽象的な話ではなく、実際のビジネス現場でどのような成果が出ているのか見ていきましょう。2024年から2025年にかけて、導入企業では劇的なROI(投資対効果)が報告されています。

1. 顧客対応:H&Mと画像解析の融合

ファッション大手のH&Mなどは、マルチモーダル機能を活用したバーチャルアシスタントを導入しています。従来、顧客が「この服に合うズボンは?」と聞いてもテキストだけでは限界がありました。

しかし、マルチモーダルエージェントは顧客がアップロードした画像を認識し、在庫データベースから最適な商品を提案できます。報告によると、問い合わせの70%を自律的に解決し、購入コンバージョン率が大幅に向上した事例もあります。

2. 公共・事務:41,000時間の削減

米国疾病予防管理センター(CDC)の事例は、事務処理におけるエージェントの威力を示しています。彼らはAIを活用して、膨大な公衆衛生データの処理や文書作成を自動化しました。

このように、単なる「チャット」ではなく、データベースへのアクセスや形式変換といった「作業」をエージェントに任せることで、組織全体で数万時間規模の工数削減が可能になります。

3. 物流・サプライチェーン:DHLの予測と対応

物流大手のDHLなどの先進企業では、レポート(テキスト)、衛星画像(視覚)、交通ニュース(テキスト/音声)を統合分析するエージェントを導入しています。これにより、配送遅延のリスクを自律的に予測し、ルート変更をドライバーに指示するプロセスを自動化。納期遵守率が30%向上したというデータもあります。

導入のための3ステップ・ロードマップ

「すごい技術だとは思うが、何から始めればいいかわからない」という方のために、失敗しない導入ステップを提案します。

Step 1: 「マルチモーダル」が活きるタスクの棚卸し

すべての業務にAIを使う必要はありません。以下の条件に当てはまる業務を探してください。

- 視覚情報が必要か?(例:請求書の画像読み取り、画面操作、デザイン確認)

- 複数のツールをまたぐか?(例:メール→Excel→Webシステム)

- 判断基準が曖昧か?(例:クレームの緊急度判定)

Step 2: 小規模なパイロット運用(PoC)

いきなり全社導入は危険です。まずは特定の部署(例:経理部の領収書処理)に限定し、Microsoft Copilot Studioや、より専門的なエージェント構築ツール(CrewAIなど)を用いてプロトタイプを作成します。ここでは「精度の検証」よりも「ワークフローとして成立するか」を確認します。

Step 3: 人間参加型(Human-in-the-loop)での運用

エージェントは自律的ですが、責任は取れません。必ず「最終承認」のプロセスを人間が行うフローを設計してください。AIが下書きと入力まで行い、人間が「OK」ボタンを押すだけの状態にするのが理想形です。

知っておくべきリスクと対策

最後に、専門家としてリスクについても公平にお伝えします。

- ハルシネーション(嘘)のリスク: 画像認識でも誤読は発生します。特に手書き文字や複雑な図表の解釈には注意が必要です。

- セキュリティとプロンプトインジェクション: 悪意のある画像(見た目は普通だがAIを誤動作させるコードが含まれているなど)を読み込ませる攻撃手法が存在します。外部からの入力を直接エージェントに処理させる場合は、サニタイズ(無害化)の仕組みが必須です。

- コスト管理: 画像や動画の処理は、テキストのみに比べてトークン消費量(コスト)が跳ね上がります。API経由で利用する場合は、予算上限の設定を忘れないでください。

まとめ:2025年は「指示待ち」から「自律駆動」へ

マルチモーダルAIとエージェントの融合は、単なる業務効率化ツールではありません。それは、従業員一人ひとりに「優秀な専属アシスタント」をつけることに等しい変革です。

「見て、聞いて、考えて、動く」AIを使いこなせる企業と、そうでない企業の生産性格差は、2025年以降決定的に開いていくでしょう。まずは、あなたの身の回りの「視覚を使う定型業務」を見つけることから始めてみてください。それが、ビジネスを変革する第一歩になります。

コメント