はじめに:なぜ今、AI Tuber開発なのか?

AIハック術師のハヤトです。

「プログラミングを勉強したいが、作りたいものがない」

「生成AIのAPIを叩くだけのアプリには飽きた」

そんなあなたに、今最もおすすめしたいプロジェクトがあります。それが「AI Tuber(AI VTuber)」の自作です。

元ネタとなった阿部由延氏の動画や書籍『AI Tuberを作ってみたら生成AIプログラミングがよくわかった件』でも語られている通り、AI Tuber開発は単なるお遊びではありません。これは、API連携、非同期処理、音声合成、リアルタイム制御といった、現代のソフトウェア開発に必要な要素がすべて詰まった「総合学習教材」なのです。

この記事では、元ネタのエッセンスを吸収しつつ、最新の技術スタック(Python + OpenAI API + VTube Studio API)を使って、実際にPC上で動くAI Tuberのプロトタイプを構築する方法を、コード付きで解説します。

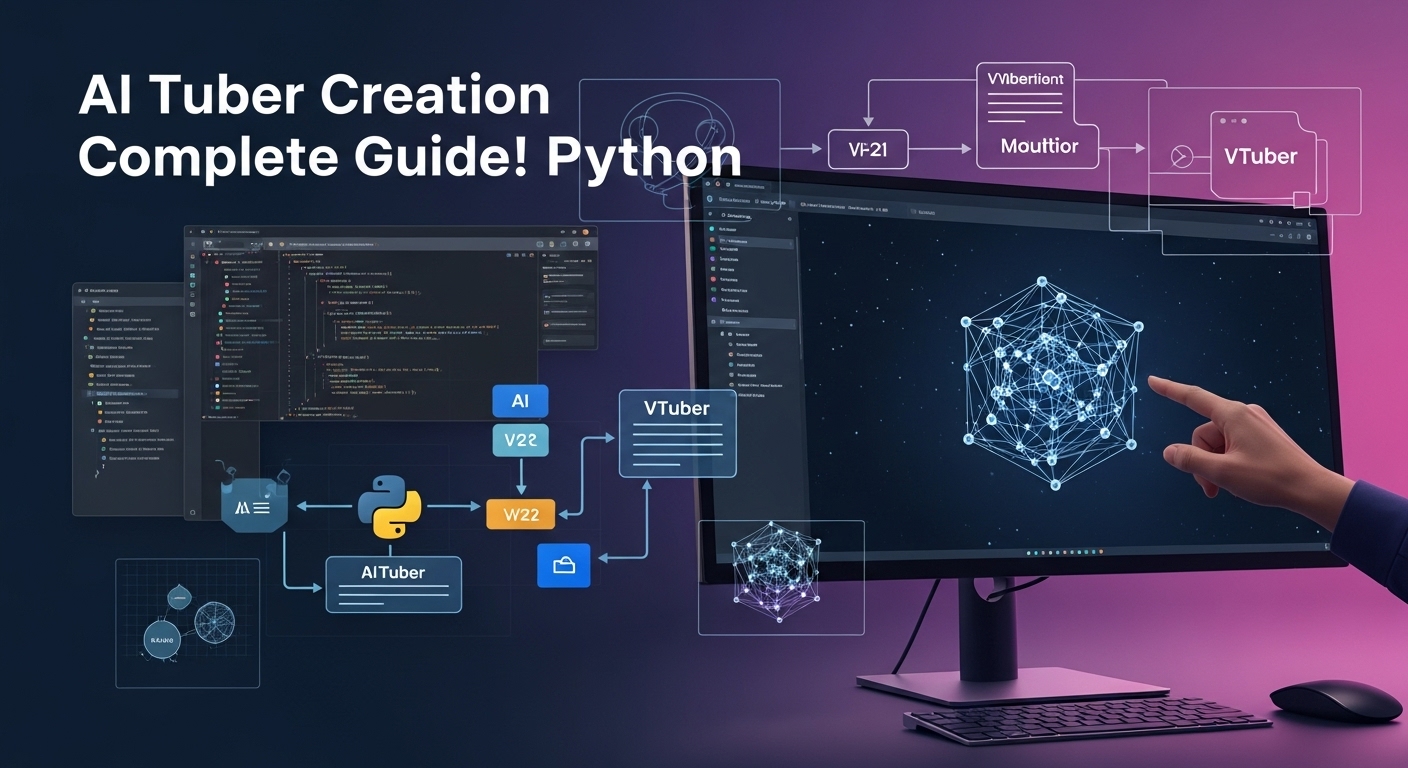

AI Tuberの仕組み:4つの「臓器」を理解する

AI Tuberは魔法ではなく、複数のAPIを繋ぎ合わせたピタゴラスイッチのようなものです。システムは大きく分けて4つのモジュール(臓器)で構成されます。

| 部位 | 役割 | 使用ツール/技術 |

|---|---|---|

| 耳 (Ears) | 視聴者のコメントを取得する | YouTube Data API |

| 脳 (Brain) | キャラ設定に基づき返答を考える | OpenAI API (GPT-4o/mini) |

| 口 (Voice) | テキストを音声データに変換する | VOICEVOX (Local API) |

| 体 (Body) | 音声に合わせて口を動かし、表情を変える | VTube Studio / VMagicMirror |

独自解説:なぜこれが「最強の教材」なのか

結論から言うと、「待機時間」の制御が必要だからです。

- コメントが来るまで待つ(ポーリング)

- AIの生成を待つ(非同期処理)

- 音声再生が終わるまで次の動作を待つ(キュー管理)

これらをスムーズに繋ぐ処理を書くことで、Pythonの実装力が飛躍的に向上します。ただのチャットボットとは次元が違う経験値が得られます。

実践ガイド:やってみよう

ここからは、実際にPythonを使って最小構成のAI Tuberシステムを組んでいきます。

※詳細なGUI作成などは省略し、「コメントを受け取って喋る」コア機能に絞ります。

Step 0: 前提環境

- Python 3.10+ がインストール済みであること

- VOICEVOX アプリ版がインストールされ、起動していること(デフォルトポート: 50021)

- VTube Studio (Steam版) がインストールされ、Live2Dモデルが表示されていること

- OpenAI API Key を取得済みであること

Step 1: 必要なライブラリのインストール

ターミナルで以下のコマンドを実行します。音声再生には sounddevice と soundfile が便利です。

pip install openai requests sounddevice soundfile numpy python-dotenvStep 2: 脳と口を作る (Brain & Voice Code)

まずは「テキストを受け取って、キャラ付けして返答し、声に出す」部分を作成します。以下のコードを aituber_core.py として保存してください。

import os

import requests

import json

import sounddevice as sd

import soundfile as sf

import io

from openai import OpenAI

from dotenv import load_dotenv

# .envファイルからAPIキー読み込み

load_dotenv()

client = OpenAI(api_key=os.getenv("OPENAI_API_KEY"))

# VOICEVOX設定 (ずんだもん: 3, 四国めたん: 2 など)

SPEAKER_ID = 3

VOICEVOX_URL = "http://127.0.0.1:50021"

# キャラクター設定(システムプロンプト)

CHARACTER_PROMPT = """

あなたは「AIずんだもん」です。

語尾に必ず「〜なのだ」や「〜のだ」をつけて話してください。

視聴者のコメントに対して、短くテンポよく返答してください。

"""

def get_ai_response(user_comment):

"""OpenAI APIで返答を生成"""

try:

response = client.chat.completions.create(

model="gpt-4o-mini",

messages=[

{"role": "system", "content": CHARACTER_PROMPT},

{"role": "user", "content": user_comment}

]

)

return response.choices[0].message.content

except Exception as e:

print(f"AI Error: {e}")

return "エラーが発生したのだ。"

def speak_text(text):

"""VOICEVOXで音声を生成して再生"""

# 1. 音声合成用のクエリを作成

query_payload = {"text": text, "speaker": SPEAKER_ID}

r = requests.post(f"{VOICEVOX_URL}/audio_query", params=query_payload)

if r.status_code != 200:

print("Voicevox Query Error")

return

query_data = r.json()

# 2. 音声データを生成

r_synth = requests.post(

f"{VOICEVOX_URL}/synthesis",

params={"speaker": SPEAKER_ID},

json=query_data

)

if r_synth.status_code == 200:

# メモリ上で音声データを読み込んで再生

data, samplerate = sf.read(io.BytesIO(r_synth.content))

sd.play(data, samplerate)

sd.wait() # 再生終了まで待機

else:

print("Voicevox Synthesis Error")

if __name__ == "__main__":

# テスト実行

print("AI Tuber起動...")

comment = input("コメントを入力: ")

reply = get_ai_response(comment)

print(f"AI: {reply}")

speak_text(reply)Step 3: 体を動かす (VTube Studio連携)

VTube Studioは、PCのマイク入力を拾って自動でリップシンク(口パク)してくれます。上記のPythonコードで音声を再生するとき、出力デバイスを「CABLE Input (VB-Audio Virtual Cable)」などの仮想オーディオデバイスに設定し、VTube Studioのマイク入力をその仮想デバイスに向けることで、スクリプトが喋ると同時にモデルの口が動きます。

さらにハックするなら、pyvts ライブラリを使って、感情に合わせて「笑顔」や「怒り」のパラメータをPythonから直接送信することも可能です。

Step 4: システム統合のヒント

実際の運用では、上記のコードを無限ループに入れ、YouTube Liveのコメント取得APIを一定間隔(例: 5秒ごと)で叩くように変更します。

YouTube APIには「クォータ(利用制限)」があります。開発中はAPIを叩かず、自分のコンソール入力で会話テストをするか、TwitchなどのWebSocket接続が可能なプラットフォームでテストすると、制限を気にせず開発できます。

まとめと次のステップ

AI Tuber開発は、生成AIの楽しさとシステム開発の泥臭さを同時に味わえる最高のプロジェクトです。

- まずは上記のコードで、「文字を入れたら声で返ってくる」体験をする。

- 仮想オーディオケーブルを使って、VTube Studioの口を動かす。

- YouTube APIキーを取得して、実際の配信に接続する。

この3ステップをクリアした時、あなたは「ただのAIユーザー」から「AIエンジニア」へと一歩踏み出しているはずです。より深い知識を得たい方は、内部リンクの記事で紹介している「全自動メディア構築」の考え方も参考にしてください。

さあ、あなたのPCの中に、あなただけのパートナーを生み出してみましょう。

コメント